12月5日,计算机与人工智能学院吴晓教授团队的论文TMM-CLIP: Task-guided Multi-Modal Alignment for Rehearsal-Free Class Incremental Learning凭借出众的创新性、清晰的逻辑以及流利的演讲,获得2024年亚洲多媒体国际学术会议(ACM Multimedia Asia 2024)最佳论文奖。这是西南交通大学在计算机和人工智能领域又一项具有显示度的标志性成果,也是吴晓教授团队继2021年获得国际多媒体建模学术会议(MMM 2021)最佳论文奖之后,再次获得国际会议最佳论文奖。

ACM Multimedia Asia(ACM MM Asia)是国际计算机协会(ACM)和美国计算协会多媒体专业组(SIGMM)主办的国际学术会议,由2000年创办的环太平洋多媒体国际会议(PCM)和2009年创办的互联网多媒体计算与服务国际会议(ICIMCS)合并重组后建立的国际会议,是多媒体领域的国际旗舰学术会议,属于中国计算机学会(CCF)推荐的C类国际会议,今年在新西兰奥克兰召开。

论文以西南交通大学为第一署名单位,2023级博士生潘圆康为第一作者,吴晓教授为通讯作者,与西南交通大学袁召全副教授、南京理工大学李泽超教授以及中国科学院自动化研究所徐常胜研究员共同合作完成。

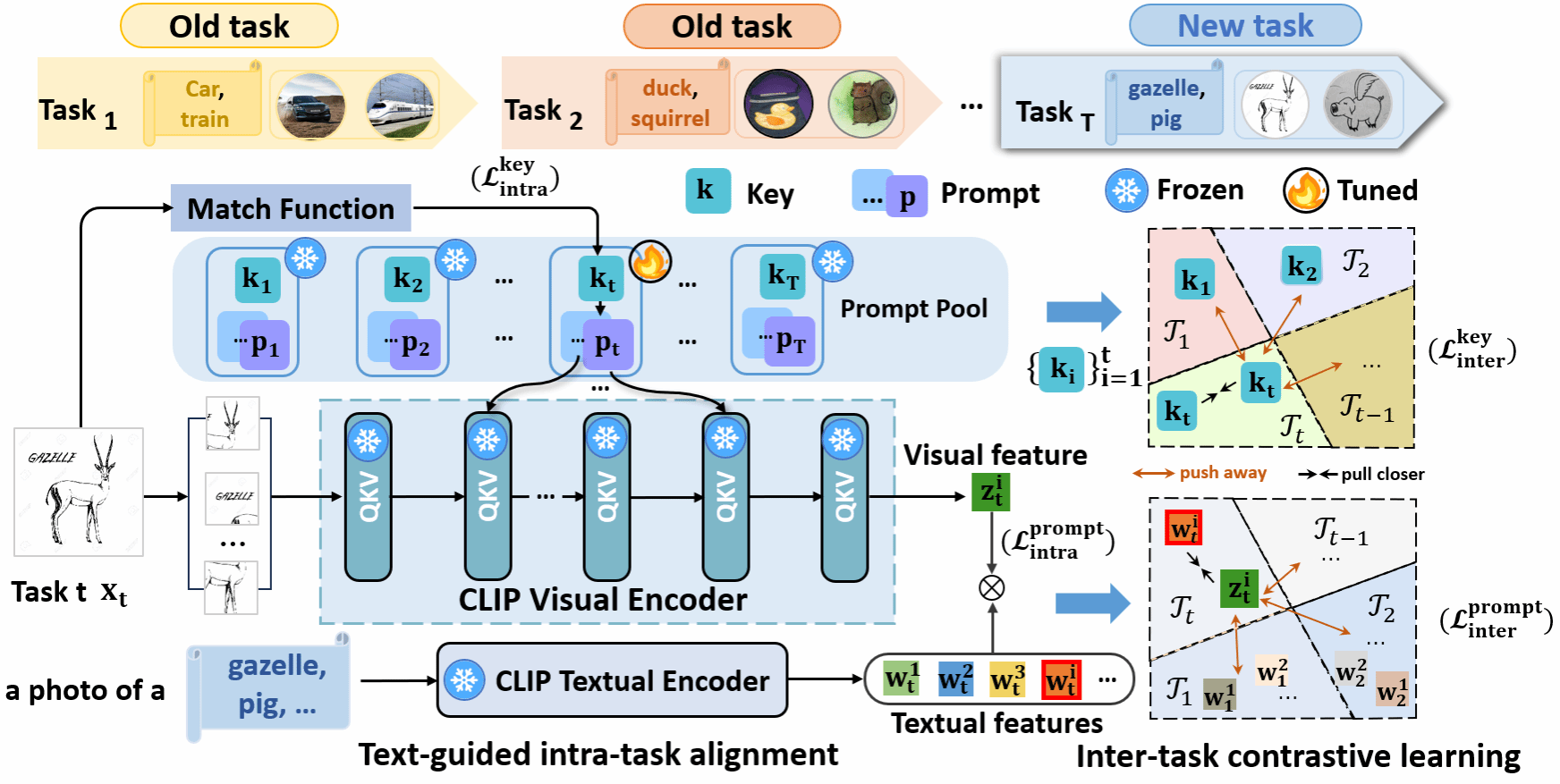

TMM-CLIP框架图

持续学习是目前人工智能的热点和关键问题,该论文研究基于视觉语言预训练大模型CLIP的类增量学习问题,揭示了在类增量的过程中视觉特征混淆所导致的知识遗忘问题,并提出相应的基于任务引导的多模态对齐方案。现有的机器学习算法通常假设训练数据是一次性获取的,但在实际应用中,随着时间推移,训练数据往往是顺序到达的。类增量学习旨在从顺序数据中持续学习新类别知识,同时避免对旧知识的遗忘,而持续的多模态对齐是实现这一目标的关键。论文首先通过实验分析了在基于CLIP的类增量学习中,顺序任务内和任务间的视觉表征混乱导致知识遗忘。为解决这一问题,设计了文本引导的视觉注意力偏移方法和任务间多模态对比学习方案。实验表明,该方法在类增量学习中表现出显著的有效性和高效性。该研究不仅为基于预训练模型的类增量学习提供了理论支持,也为类增量场景的实际落地提供了参考。

计算机与人工智能学院紧跟国际前沿热点,大力推进人工智能领域前沿研究工作,加快学科建设布局,力争在科学研究方面做出标志性成果,取得突破性进展,为学校“双一流”建设和学科高质量发展贡献力量。